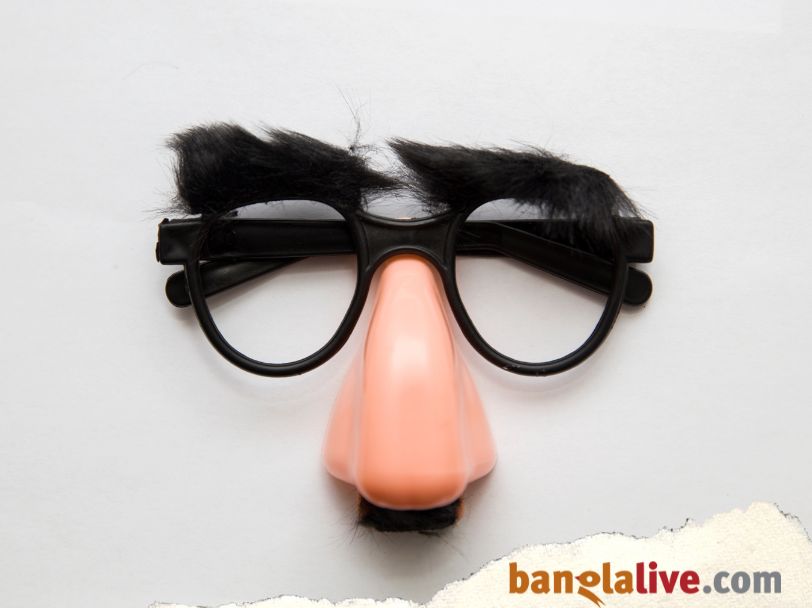

ইউটিউবে ভাইরাল হয়েছিল ভিডিওটি। ভিডিওর শুরুতেই পর্দায় ভেসে উঠছে -ওবামা যা বলছেন তা শুনলে নিজের কানকে বিশ্বাস করতে পারবেন না। এরপর দেখা যাচ্ছে হোয়াইট হাউসের ওভাল অফিসের মেহগনি কাঠের চেয়ারে বসে রয়েছেন বারাক হুসেন ওবামা। সল্ট অ্যান্ড পেপার লুকের ৪৪ তম মার্কিন প্রেসিডেন্টের পরনে নিভাঁজ শাদা শার্ট, নীল টাই। সোজা ক্যামেরার দিকে তাকিয়ে ওবামা বলছেন, “আমরা এমন এক সময়ে এসে পড়েছি যখন আমাদের দুশমনরা যে কোনও সময় যাকে ইচ্ছে তাকে দিয়ে যা খুশি বলাতে পারে। তবে তারাও বেফাঁস কিছু বলবে না।” এই পর্যন্ত বলে হোয়াইট হাউসে তাঁর উত্তরসূরী ডোনাল্ড ট্রাম্পকে একটা বিশেষনে ভূষিত করে ওবামা বলছেন, “দেখুন আমি এই ধরনের কথা কিন্তু প্রকাশ্যে কখনই বলব না।” (Deep Fake)

চূড়ান্ত ভাইরাল হওয়া এই ভিডিওটি কিন্তু সত্যি নয়। ওবামা মোটেও এসব কথা বলেননি। হলিউডের দুই চিত্র পরিচালক জর্ডন পিল আর বাজফিড মিলে কৃত্রিম বুদ্ধিমত্তা বা আর্টিফিসিয়াল ইনটেলিজেন্স (যাকে সংক্ষেপে এআই বলা হয়) এর সাহায্যে এই ভিডিওটা বানিয়েছেন। উদ্দেশ্য এই নবজাতক মাধ্যমের অন্ধকার দিকটা জনমানসে তুলে ধরা। তাই ভিডিওতে প্রাক্তন মার্কিন প্রেসিডেন্টকে বলতে শোনা যাচ্ছে, “এখন থেকে নেট দুনিয়ার তথ্য বিশ্বাস করার আগে আরও সতর্ক হতে হবে। নির্ভরযোগ্য সংবাদমাধ্যমকেই বিশ্বাস করতে হবে। হয়তো কথাটা খুব সোজা সাপটা লাগছে কিন্তু শেষ হিসাবে এটাই আমাদের মরণ বাঁচন সমস্যা হয়ে দাঁড়াবে।”

সিন্থেটিক মিডিয়া ও ডিপফেক

এআই বিশেষজ্ঞ নীনা স্কিচিক তাঁর ‘ডিপফেকস-অ্যান্ড দ্য ইনফোক্যালিপস’ বইতে এইরকম- সম্পূ্র্ণভাবে এআই এর তৈরি অথবা সম্পাদিত ছবি, অডিও এবং ভিডিও এর নাম দিয়েছেন সিন্থেটিক মিডিয়া বা কৃত্রিম সংবাদমাধ্যম। অর্থাৎ যে ঘটনার কোনও অস্তিত্ত্ব নেই বা যে ঘটনা অতীতে কখনও ঘটেনি তাকেই এআই দিয়ে তৈরি করলে সেটি সিন্থেটিক মিডিয়া। নীনার মতে, যখন কোনও অশুভ উদ্দেশ্যে মিথ্যাকে জনমানসে ছড়িয়ে দেওয়ার জন্য এই সিন্থেটিক মিডিয়াকে ব্যবহার করা হয় তখন সেটা হয় ডিপফেক। অর্থাৎ বাস্তবকে নিজের ইচ্ছামতো সম্পাদনা করে দেখালেই হল না, এর পিছনের উদ্দেশ্যটাও দেখতে বলছেন নীনা। তবে পাশাপাশি নীনা এও বলছেন, নবজাতক এই মাধ্যমের এ হল প্রাথমিক নামকরণ। এটি চূড়ান্ত নয়। প্রযুক্তির সঙ্গে তাল মিলিয়ে চলার জন্য পরবর্তীকালে অন্য নাম হতেই পারে।

কিন্তু তাতে এই ফেক ও ডিপফেকের রমরমা বিন্দুমাত্র কমেছে কি? বরং যত দিন যাচ্ছে এআইয়ের হাত ধরে নিখুঁত কাল্পনিক ছবি, অডিও, ভিডিও ছেয়ে গিয়েছে সোশ্যাল মিডিয়ায়। অনেক সময়ই সত্যি মিথ্যা বোঝা ভার হয়ে দাঁড়াচ্ছে। ফেসবুকের মতো সামাজিক মাধ্যমে নিজের বিভিন্ন বয়স, বিভিন্ন বয়সের ছবি এই দিয়ে ফেক করিয়ে আমজনতা হয়তো নির্মল আনন্দ পাচ্ছে। কিন্তু এখন ধীরে ধীরে এই ফেক ছবি, ভিডিও ফেক খবরের হাতিয়ার হয়ে ওঠার শঙ্কা হওয়ার কারণ হয়ে দাড়িঁয়েছে। মূলত সেলিব্রটিদের এই ডিপফেকের শিকার বানানো হচ্ছে কারণ এতে নেটদুনিয়ায় দ্রুত ছড়িয়ে পড়া সহজ। তাই এই ডিপফেকের শিকার সেলিব্রিটির তালিকা ক্রমশ বাড়ছে। কে নেই ক্রমশ দীর্ঘায়িত এই তালিকায়? ইংল্যান্ডের প্রয়াত রাণী দ্বিতীয় এলিজাবেথ, ইজরায়েলী সুপারস্টার গাল গাডোট, হলিউড স্টার স্কারলেট জোহানসন, গায়িকা টেলর সুইফ্ট থেকে দক্ষিনী সুপারস্টার রশ্মিকা মান্দানা, বলিউড সুপারস্টার ক্যাটরিনা কাইফ, কাজলের মতো সেলিব্রিটিরা।

তবে বিশেষজ্ঞদের চিন্তা অন্য জায়গায়। তাঁদের মতে, নিছক ডিপফেককে বিনোদন হিসাবে ভাবলে ঠিক আছে। কারণ ফটোশপ করে একজনের মুণ্ড আর একজনের ধড়ে বসানো বা কোনও ছবিতে ফটোশপ করার মতো ঘটনা এখন আকছার ঘটে এবং এইরকম ঘটনা নজরে এলে সঙ্গে সঙ্গে ব্যবস্থাও নেওয়া হয়। তবে সিনেমার মতো মিডিয়াতেও কাল্পনিক অডিও, ভিডিও বা ছবি চলে এলে আশঙ্কা অন্য জায়গায়। পর্ণোগ্রাফি, ব্ল্যাকমেইল, শাসানো, প্রতিহিংসা চরিতার্থ করার মতো অপরাধমূলক কাজেও ডিপফেককে ব্যবহার করা হতে পারে। তাছাড়া ডিপফেক ভুয়ো খবর ছড়িয়ে মিডিয়া ও জনমানসে বিভ্রান্তি ছড়াতে পারে। মনস্তত্ত্ববিদরা ডিপফেককে মানসিক অবসাদের সম্ভাব্য কারণ হিসাবেও দেখছেন।

ডিপফেকের রমরমা

বহুজাতিক উপদেষ্টা সংস্থা কেপিএমজির হিসাবমতো, এখনও পর্যন্ত নেট দুনিয়ায় লক্ষাধিক ফেক ছবি ঘোরাফেরা করছে এবং যত সময় যাচ্ছে সংখ্যাটা বাড়ছে। ডাচ ভার্চুয়াল থ্রেট ইনটেলিজেন্স সংস্থা সেন্সিটি ২০২০ সালেই বলেছিল ৮৫ হাজার ফেক ভিডিও নেট দুনিয়ায় রয়েছে। শুধু তাই নয়, প্রতি ৬ মাস অন্তর এর সংখ্যা দ্বিগুণ হচ্ছে।

ডিপফেক চিহ্নিতকরণকারী সংস্থা সামসাব এক হিসাবে জানাচ্ছে ২০২৩ এর তুলনায় ২০২৪ এ প্রায় ২৪৫ শতাংশ ডিপফেক বেড়ে গিয়েছে। আগের বছরের তুলনায় বর্তমান বছরে দক্ষিণ কোরিয়া (১৬৫০ শতাংশ), ইন্দোনেশিয়া (১৫৫০ শতাংশ) এর মতো নির্বাচন নির্ধারিত দেশগুলোতেও প্রচণ্ড বেড়ে গিয়েছে। তবে ভোট নেই এমন দেশগুলোও বাদ যায়নি ডিপফেকের বাড়বাড়ন্তের হাত থেকে। চিনেই ২০২৪ সালে তার আগের বছরের চেয়ে ডিপফেক বেড়েছে ২৮০০ শতাংশ। একইসময়ে সিঙ্গাপুরে বেড়েছে ১১০১ শতাংশ। বস্তুত এক মন্ত্রীর ফেক ভিডিও নিয়ে সারা সিঙ্গাপুরে হইচই পড়ে যায়।

সম্প্রতি আর্থিক উপদেষ্টা সংস্থা হাইপারিয়ন তাদের এক রিপোর্টে বলছে বর্তমানে এক তৃতীয়াংশ আর্থিক কেলেঙ্কারির পিছনে কলকাঠি নাড়ছে এআই। পরিসংখ্যান বলছে, বিগত তিন বছরে আর্থিক ক্ষেত্রে এই ধরণের ডিপফেকের হামলা বেড়েছে ২১৩৭ শতাংশ। ব্যাঙ্কিং ক্ষেত্রই এইধরণের ডিপফেকের হামলার অন্যতম প্রধান শিকার। ওয়ার্ল্ড ইকোনমিক ফোরামের হিসাবে ডিপফেকের জালিয়াতির জেরে ছোট ও মাঝারি সংস্থাগুলি ২০২৩ সালে ৪ লক্ষ ৮০ হাজার ডলার বা ৩ কোটি ৯৮ লক্ষ টাকার লোকসানের মুখে পড়েছে।

চিন্তার আরও কারণ হল দুনিয়াজুড়ে সাধারণ কৃত্রিম বুদ্ধিমত্তা বা জেনেরেটিভ এআই এর ক্রমবর্ধমান রমরমা। ওপেন এআই এর চ্যাটবটতো এক প্রকার বিশ্বজয় করেই ফেলেছে। পরিসংখ্যান বলছে ২০২২ সালেই নেটদুনিয়ার ৮৮ শতাংশ ব্যবহারকারী কোনও না কোনওসময়ে চ্যাটবট ব্যবহার করেছে। ২০২৩ এর এক হিসাব বলছে কাজের আড়াইশো কোটি ঘণ্টা সময় বাঁচিয়েছে চ্যাটবট। বিশ্বজোড়া ব্যবসার খতিয়ান বলছে যেখানে ২০১৮ সালে চ্যাটবট ব্যবসা করেছিল ৪ কোটি ৯০ লক্ষ ডলারের, সেখানে ২০২৭-এ তা ১১গুন বেড়ে ৪৫ কোটি ৫৮ লক্ষ ডলার ছোঁবে বলে মনে করা হচ্ছে। বিশেষজ্ঞরা বলছেন এআইয়ের রমরমা যত বাড়ছে তত ফেক ও ডিপফেকের প্রসার ঘটছে।

ডিপফেকের এত রমরমার আরেক কারণ আমজনতার হাতে এআইয়ের এই প্রযুক্তির সহজলভ্য হওয়া। বিগত শতকের ৯০ এর দশকেও ফটোশপ দিয়ে একটু আধটু ছবি সম্পাদনা করা যেত। কিন্তু এআই এসে সব কিছুই এক লহমায় পাল্টে দিল। ছবি বা ভিডিও নিয়ে কিছু করার জন্য এখন আর দামি কম্পিউটার গ্রাফিক্স স্টুডিও লাগবে না, সাধারণ কোনও ঘরে বসেই গেমিং কনসোল চলার মতো গ্রাফিক্স কার্ড আর অনলাইনে সহজলভ্য এআই এর মেশিন লার্নিং সফটওয়্যার হলেই কাজ হয়ে যাবে। আর এখন আধুনিক স্মার্টফোনে এআই অনেকসময় নিজেই সেই কাজ করে দিচ্ছে। ফলে ডিপফেকও ক্রমশ আমজনতার হাতের নাগালে চলে আসছে। পরিসংখ্যান বলছে বিশ্বে ৬৮৪ কোটি স্মার্টফোন রয়েছে। মাইক্রোসফট, অ্যাপেল, স্যামসুঙের মতো বহুজাতিক স্মার্টফোন নির্মাতা সংস্থা হ্যান্ডসেটে পরিষেবা বাড়ানোর লক্ষ্যে ব্যাপকহারে এআই ব্যবহার করা শুরু করছে। এআই স্মার্টফোনের ব্যবহার যত বাড়বে ততই যে ডিপফেক লাগামছাড়া হবে তা তো বলাই বাহুল্য।

ডিপফেকের কথা

প্রথমেই জেনে নেওয়া যাক ডিপ ফেক কাকে বলে?

‘ডিপফেক’ এই নামটা আদতে এসেছে ‘ডিপ লার্ণিং’ আর ‘ফেক’ শব্দদুটোকে জুড়ে।

ডিপফেকের জন্মবৃত্তান্ত শতবর্ষ প্রাচীন। বিগত শতকের বিশের দশকে ব্রিটিশ গাণিতজ্ঞ তথা কম্পিউটার সায়েন্সের জনক অ্যালান টুরিং এর মনে প্রশ্ন জাগে, “যন্ত্র কি ভাবতে পারে? দ্বিতীয় বিশ্বযুদ্ধ চলাকালীন বিজ্ঞানীরা মনোযোগী হন গাণিতিক তত্ত্ব, ইলেকট্রনি্ক্স আর অটোমেশন নিয়ে, যাতে বিজ্ঞানের ফলিত রূপকে যুদ্ধের কাজে লাগানো যায়। এই উদ্দেশ্য মাথায় রেখে কণ্ঠস্বর চেনা, মুখাবয়ব চেনা বা ফেসিয়াল রেকগনিশনের রাস্তা তৈরি হয়। যেমন ১৯৪৩ সালে শিকাগোর ইলিনয়েস বিশ্ববিদ্যালয়ের ওয়ারেন ম্যাককুলাহ আর ওয়াল্টার পিটস নামে দুই বিজ্ঞানী এক গবেষণাপত্র প্রকাশ করেন যা আদতে টুরিংয়ের ধারণাকেই আরও জোরালো করে। এই দুই মার্কিন বিজ্ঞানী দেখান যে নিউরন নেটওয়ার্ক তৈরি করলে সেখান থেকে প্রশ্নের উত্তর ঠিকঠাক আসে। ১৯৫০ সালে খোদ টুরিং প্রকাশ করেন ‘কম্পিউটিং মেশিনারি অ্যান্ড ইন্টেলিজেন্স’ নামে এক গবেষণাপত্র, যেখানে ‘টুরিং টেস্ট’ এর কথা বলা হয়। এই টেস্টে রয়েছে ‘গেম অফ ইমিটেশন’ যেখানে মানুষ বুঝতে পারবে সে আরেকজন মানুষ না কোনও যন্ত্রের সঙ্গে কথা বলছে। এই যুগান্তকারী গবেষণাপত্রই যে এআই এর বীজ রোপন করেছিল তা বলাই যায়।

এরপর যন্ত্রকেও যাতে বুদ্ধিমান করা যায়, যাতে পরিস্থিতি অনুসারে মানুষের মতো সেও সিদ্ধান্ত নিতে পারে- এরই খোঁজে নেমে পড়েন বিজ্ঞানীরা। শুরু হয় এআই নিয়ে গবেষণা। ফ্র্যাঙ্ক রোজেনব্লাট প্রথম নিউট্রাল নেটওয়ার্কের নকশা করেন। তবে আর্থার স্যামুয়েলের ‘মেশিন লার্নিং’ এসে এক ঝটকায় টুরিং ধারণার বাস্তবায়ন করে। স্যামুয়েলের প্রোগ্রামিং সফটওয়্যারে যন্ত্র চেকার্স খেলায় তৎকালীন বিশ্বের এক প্রথম সারির খেলোয়াড়কে হারিয়েও দেয়।

কিন্তু এআই এর প্রগতির পথে বাধা হয়ে দাঁড়ায় প্রসেসিং পাওয়ার ক্ষেত্রে উন্নতি না হওয়া। এমনকি ১৯৭৬ সালে রোবোটিক বিজ্ঞানী হান্স মোরাভেক বলে বসেন, “বুদ্ধিমত্ত্বা দেখানোর থেকে কম্পিউটার এখনও লক্ষ যোজন দূরে।” শুরু হল প্রথম ‘এআই শীতকাল’।

৮০ এর দশকে এসে এআই গবেষণা দুটো স্বতন্ত্র খাতে বইতে শুরু করে। একদল বিজ্ঞানী নির্দিষ্ট প্রোগ্রামিং ল্যাঙ্গুয়েজ অনুসারে কম্পিউটারকে কাজ করানোর দিকে মন দেন। অর্থাৎ যা নির্দেশ দেওয়া হবে এআই সেই ধরাবাঁধা রাস্তায় চলবে।

কিন্তু আরেকদল বিজ্ঞানী এই ধরাবাঁধা এআই এর পথে যেতে চাইলেন না। ‘ততদিনে আইবিএম এর ডিপ ব্লু সুপারকম্পিউটার এসে গিয়েছে। এক ঝটকায় কম্পিউটারের প্রসেসিং ক্ষমতা কয়েক লক্ষ গুন বেড়ে গিয়েছে। উল্লেখ্য এই ডিপ ব্লু সুপারকম্পিউটারের সঙ্গে ১৯৯৭ সালে তৎকালীন বিশ্ব চ্যাম্পিয়ন দাবাড়ু গ্যারি কাসপারভ দাবা খেলেন।

টুরিং-স্যামুয়েলের পথে যেতে চাওয়া বিজ্ঞানীরা আর কালক্ষেপ করলেন না। কোমর বেঁধে নেমে পড়লেন গবেষণায়। শেষ হল ‘এআই শীত’। স্যামুয়েলের মডেল ধরে তাঁরা চাইলেন মানুষের মতোই অভিজ্ঞতা বা ‘লার্নিং’ সঞ্চয় করে এআই এগোক। ২০০০ সাল নাগাদ বিজ্ঞানীরা দেখেন এই ‘মেশিন লার্নিং’ এর পথে এআই গবেষণাকে এগিয়ে নিয়ে যাওয়া সম্ভব। দেখা গেল যদি মানুষের মস্তিষ্কের আদলে কৃত্রিম নেটওয়ার্ক সৃষ্টি করা যায়, সেই নেটওয়ার্কে যথেষ্ট তথ্য দেওয়া যায় তবে যন্ত্রও তখন তার অভিজ্ঞতাকে পূঁজি করে সিদ্ধান্ত নিতে সক্ষম হবে। একেই ‘ডিপ লার্নিং’ আখ্যা দেওয়া হল। অর্থাৎ শুধু নেটদুনিয়ায় প্রাপ্ত তথ্যকে সম্বল করে এআই যে এগোচ্ছে তাই নয়, পরিস্থিতি অনুসারে নিজেকে পাল্টাচ্ছে। অনেকটা জীবজগতের মিউটেশনের মতো।

আর এতেই প্রমাদ গুনেছেন বিজ্ঞানীরা। যান্ত্রিক মস্তিষ্ক যেন মানব মস্তিষ্ককে না ছাপিয়ে যায় সেটাই যখন এআই ক্ষেত্রে মূল শীরঃপীড়া হয়ে দাঁড়াচ্ছে, তখনই এ আই এর আরেক ফলিত রূপ ডিপফেক রঙ্গমঞ্চে আবির্ভূত হয়েছে।

এই পরিপ্রেক্ষিতে ওপেন আই-এর বর্তমান ‘স্ট্রবেরি’ প্রকল্প উল্লেখযোগ্য। সংবাদ মাধ্যমের তথ্য অনুসারে স্যাম অল্টম্যানের নেতৃত্বাধীন সংস্থা এই প্রকল্পে এআই-এর এমন মডেল নিয়ে কাজ করছে যা সাধারণ এআই মডেলের মতো সাধারণ প্রশ্নের উত্তরই শুধু দেবে না, জটিল গাণিতিক সমস্যার সমাধানও করবে। শুধু এই নয়, গবেষণার কাজেও সহায়তা করবে এই এআই মডেল।

ডিপফেক বোঝা যাবে কী করে?

মাসাচুসেটস ইনস্টিটিউট অফ টেকনোলজি (এমআইটি) এর ‘ডিটেক্ট ফেক প্রজেক্ট’ একটা মোটামুটি ধারণা দিয়েছে বিষয়টা সম্পর্কে তা হল এইরকম-

প্রথমত ছবির মানুষের চিবুক আর কপাল খেয়াল করতে হবে। দেখতে হবে সেখানে ত্বক অস্বাভাবিক মসৃন বা বলিরেখা রয়েছে কী না।

দ্বিতীয়ত মানুষটার ছায়ার দিকেও নজর দিতে বলছেন বিশেষজ্ঞরা। মুখের কোনও অসংলগ্ন ছায়া পড়ছে না তা দেখতে হবে। ভিডিওতে নজর রাখতে চলাচলের সঙ্গে চশমার কাঁচ থেকে প্রতিফলিত আলো পাল্টাচ্ছে কী না।

তৃতীয়ত মুখের ধরণও দেখতে হবে। খেয়াল করতে হবে মুখ কি স্পষ্ট নিঁখুত দেখা যাচ্ছে না আবছা লাগছে।

চতুর্থত আগে ডিপফেক ভিডিওতে চোখের পলক পড়ত না। কিন্তু এখন প্রযুক্তির কল্যানে সেই ত্রুটি কাটিয়ে উঠেছে ডিপফেক নির্মাতারা। তাই এখন বরং খেয়াল করতে পলক পড়ায় কোনও অসংলগ্নতা রয়েছে কী না।

পঞ্চমত ফেক ভিডিও ধরার আরেক উপায় ঠোঁট নড়া আর কণ্ঠস্বরের তালমিল হচ্ছে কী না তা দেখা।

শেষ কথা

মাইকেল গ্রোথাস তাঁর ‘ট্রাস্ট নো ওয়ান’ বইতে লিখছেন, “ডিপফেক বিশ্বের অনেক কিছু ধ্বংস করতে পারে। তবে সবচেয়ে ভয়ঙ্কর হবে পারস্পরিক বিশ্বাস নষ্ট করা।”

সেক্ষেত্রে মানব সভ্যতার মারিয়ানা ট্রেঞ্চ হতেই পারে ডিপফেক।

তথ্য সূত্র

(১) মাইকেল গ্রোথাস-‘ট্রাস্ট নো ওয়ান’,

(২) নীনা স্কিচিক-‘ডিপফেকস-অ্যান্ড দ্য ইনফোক্যালিপস’

মূলত শিল্প বাণিজ্য ও প্রযুক্তি বিষয়ক সাংবাদিকতায় ব্যপ্ত বিগত তিন দশক। তবে সুযোগ পেলে ক্যামেরা নিয়ে বেড়িয়ে পড়া বা অন্য ধরনের লেখাতে প্রাণের আরাম খোঁজার চেষ্টাও চলে